Articles

La communauté française de la robotique a été conviée le mardi 27 janvier 2026 à l’Hôtel Cassini, au Secrétariat général pour l’investissement, dans le cadre de l’appel à manifestation d’intérêt « Stratégie nationale Robotique et Machines intelligentes – Etape 2 » de France 2030.

Occasion pour M. Bruno Bonnell, Secrétaire général pour l'investissement, de lancer un message sans ambiguïté : la France et l’Europe doivent inventer leurs propres modèles en robotique et en intelligence artificielle, sans se contenter d’imiter ceux des grandes puissances internationales. C'est une question de survie, il faut impérativement bâtir une souveraineté technologique durable, capable de renforcer la résilience industrielle européenne.

Cette ambition repose sur une vision claire : faire de la robotique un levier d’augmentation de l’humain, et non une simple automatisation. Cela implique de repenser les processus industriels autour d’architectures modulaires, polymorphes, interopérables, collaboratives et ouvertes, adaptées aussi bien aux infrastructures critiques qu’aux marchés émergents.

Face à la concurrence mondiale, le renforcement des écosystèmes européens apparaît comme une nécessité. La coopération entre la recherche, les start-up, les PME, les ETI, les grands groupes industriels et les utilisateurs finaux est identifiée comme un facteur clé pour concevoir, développer et industrialiser des solutions souveraines en IA générative, robotique et modèles numériques, tout en intégrant les valeurs européennes d’acceptabilité, de sécurité et de frugalité.

Les acteurs ont été appelés à s’engager concrètement en rejoignant les consortiums publics-privés portés par les appels à projets français et européens. Une dynamique collective essentielle pour faire émerger des innovations de rupture, souveraines et utiles à la société, au cœur des travaux du Comité Robotique France. Ainsi, le Comité a organisé quatre ateliers afin de contribuer à l'élaboration des contours du futur dispositif « Flagships IA & Robotique » de France 2030 [Annonce à venir].

Du 30 mars au 2 avril 2026, le salon Global Industrie a rassemblé les principaux acteurs de l’industrie et de l’innovation. À cette occasion, le Comité Robotique France a marqué une présence forte avec un pavillon dédié, installé au cœur de l’Espace Recherche et Innovation, une nouveauté de cette édition. Ce positionnement stratégique a permis de mettre en lumière les réalisations de 13 des 15 projets lauréats des Défis « transfert robotique », à l’issue d’une année de collaboration entre laboratoires, industriels et startups.

Tout au long du salon, ce pavillon a constitué un point de rencontre privilégié pour les acteurs de la robotique et de l’intelligence artificielle, favorisant les échanges autour des enjeux de transfert technologique et de passage à l’échelle industrielle.

Le pavillon du Comité Robotique France © Pierre Bitard / Comité Robotique France

Le 31 mars s’est tenu le troisième comité de pilotage du Comité Robotique France. Cette réunion a permis de faire un point d’étape sur la montée en maturité des projets et des consortiums, en vue de leur intégration dans des démarches de type Flagships [Annonce à venir]. Les discussions ont également porté sur les actions engagées par le Comité, les perspectives européennes, ainsi que la préparation aux futurs appels à projets en robotique et intelligence artificielle. L’interfaçage entre initiatives nationales et européennes a été identifié comme un levier clé pour renforcer l’impact des projets soutenus.

Le même jour, le séminaire « Ingénierie des systèmes robotiques et transfert de technologies » a réuni experts académiques et industriels autour des grandes orientations de la stratégie robotique nationale et européenne. Les échanges ont permis de mettre en perspective les dispositifs structurants tels que les PEPR, les agences de programme, ainsi que les initiatives européennes comme les TEF et les EDIH (voir présentation sur ce site). Plusieurs acteurs industriels sont également intervenus pour partager leurs retours d’expérience, illustrant concrètement les enjeux d’intégration de l’intelligence artificielle dans les systèmes robotiques.

Séminaire du Comité Robotique France à Global Industrie ©TINTA/Comité Robotique France

Le 1er avril, le pavillon du Comité Robotique France a accueilli la visite de M. Sébastien Martin, Ministre délégué auprès du ministre de l’Économie, des Finances et de la Souveraineté industrielle, énergétique et numérique, chargé de l'Industrie. Cette déambulation a été l’occasion de valoriser les projets soutenus dans le cadre des Défis « transfert robotique » et de favoriser les échanges entre représentants institutionnels, chercheurs et industriels. Une présentation sur la Grande scène, consacrée au rôle de la collaboration et du transfert dans le développement de la robotique, est venue compléter ce temps fort.

M. Sébastien Martin, Ministre de l’Industrie de passage sur le pavillon serrant la main de Pierre Bitard (Comité Robotique France, ANRT)

Enfin, le 2 avril a été marqué par plusieurs interventions et prises de parole, dont une interview sur GI TV ainsi que des échanges au sein de l’espace « Booster ». Une table ronde dédiée au rôle de la robotique et de l’intelligence artificielle comme accélérateurs concrets pour l’industrie a permis de prolonger les discussions engagées durant le salon, en mettant en avant des cas d’usage et des retours d’expérience. Par sa présence et la diversité des actions menées, le Comité robotique confirme son rôle structurant dans l’écosystème français de la robotique, en favorisant le dialogue entre recherche, industrie et politiques publiques, au service de l’innovation et de la compétitivité.

Lors du salon Global Industrie Paris 2026, l’entreprise française Enchanted Tools a présenté sa vision singulière de la robotique humanoïde notamment durant le séminaire du Comité Robotique France. Loin des approches purement techniques ou industrielles, la société propose une nouvelle génération de robots conçus pour interagir avec les humains de manière naturelle, intuitive… et même émotionnelle. Rencontre avec les Mirokaï !

Un Mirokaï dans la nature © Comité Robotique France / TINTA

La conviction d’Enchanted tools est que pour que les robots soient acceptés dans nos environnements du quotidien, ils doivent être pensés non seulement comme des machines performantes, mais comme des présences sociales. Enchanted Tools s’appuie ainsi sur des expertises issues à la fois de l’ingénierie robotique, de l’intelligence artificielle et… de l’animation et du design de personnages.

Une robotique pensée pour des usages concrets

Le robot humanoïde Mirokaï Explorer Suit incarne pleinement cette ambition. Conçu et fabriqué en France, il a été imaginé pour évoluer dans des environnements où la technologie doit s’effacer derrière la relation humaine. Hôpitaux, lieux d’accueil, espaces dédiés aux enfants ou encore accompagnement des équipes de soin : autant de contextes dans lesquels la présence d’un robot ne peut se limiter à une simple exécution de tâches.

Dans ces situations, la performance technique, aussi avancée soit-elle, ne suffit pas. Ce qui fait la différence, c’est la capacité à instaurer une interaction naturelle, à inspirer confiance et à apaiser. Enchanted Tools a donc fait le choix de travailler sur une dimension souvent négligée en robotique : l’expérience humaine. Le Mirokaï se distingue ainsi par une expressivité soignée, une qualité d’échange pensée pour être fluide et intuitive, et une intégration harmonieuse dans des environnements complexes, où humains et machines doivent cohabiter sans friction.

©Enchanted Tools

Le concept d’“embodied AI”, ou intelligence artificielle incarnée, est au cœur de l’approche d’Enchanted Tools. Ici, l’intelligence ne se limite pas à un logiciel distant ou abstrait : elle est directement liée au corps du robot, à ses capteurs, à ses mouvements et à l’environnement dans lequel il évolue. Le Mirokaï ne se contente pas de traiter de l’information, il la vit, en quelque sorte, à travers son interaction avec le monde réel.

Pour cela, il s’appuie sur une combinaison de technologies avancées qui lui permettent de dialoguer de manière fluide, de reconnaître la parole et les émotions dans plusieurs langues, mais aussi de comprendre ce qui se passe autour de lui grâce à des modèles croisant vision et langage. Il est capable d’identifier les visages dans le respect des contraintes réglementaires, de se déplacer de façon autonome en tenant compte des dynamiques humaines, et de manipuler des objets avec précision grâce à des systèmes pilotés par l’intelligence artificielle.

Tout cela permet au robot de percevoir, de comprendre et d’agir de manière pertinente dans des situations du quotidien, en s’adaptant au contexte réel plutôt qu’en exécutant des scénarios figés.

Une architecture prête pour l’aventure

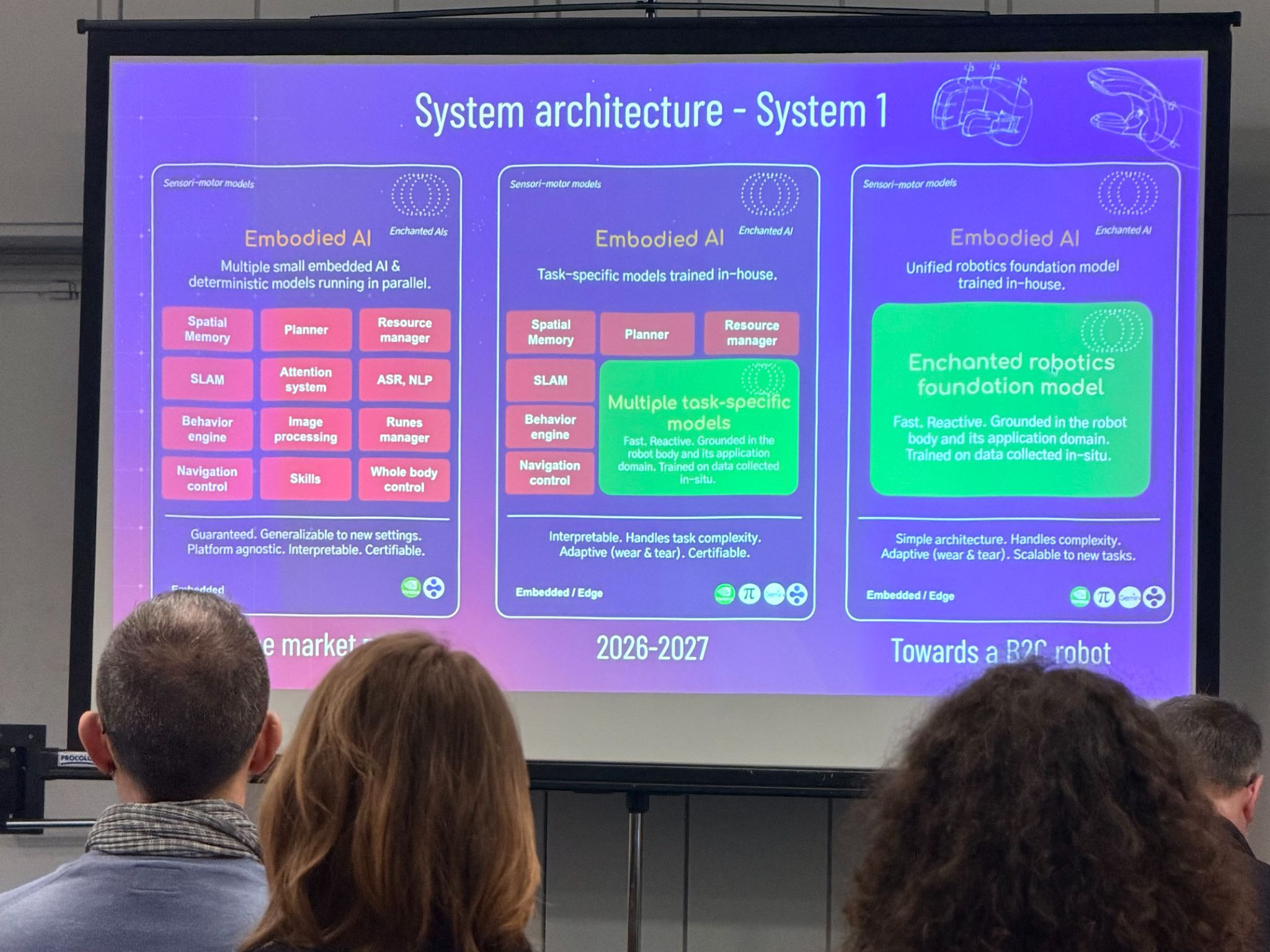

L’approche d’Enchanted Tools se distingue par une volonté assumée de rester ancrée dans le réel. Plutôt que de s’appuyer sur une intelligence centralisée unique, l’entreprise fait le choix d’une architecture hybride, où plusieurs modèles spécialisés coexistent et coopèrent. Cette organisation permet au robot de gérer des tâches complexes en mobilisant, au bon moment, les briques les plus pertinentes. À mesure que la technologie évolue, cette approche converge vers un modèle fondation unifié pour la robotique, capable de structurer et d’orchestrer ces différentes compétences au sein d’un même système.

Présentation de Enchanted tools lors du Séminaire du Comité Robotique France à Global Industrie 2026.

Ce choix architectural répond à des contraintes très concrètes. Il s’agit à la fois de garantir une grande réactivité dans l’action, de permettre au robot de s’adapter à une diversité de situations, et de tirer parti des données collectées directement sur le terrain pour améliorer ses performances. Le Mirokaï apprend ainsi en interaction avec son environnement, dans des conditions proches de celles de son usage réel.

L’ensemble repose sur un fonctionnement embarqué, au plus près du robot. Ce traitement en edge computing limite les dépendances aux infrastructures externes, réduit la latence et renforce la confidentialité des données, tout en assurant une robustesse indispensable pour des applications en environnement humain.

> Interaction avec le Mirokaï lors de Global Industrie 2026 ©Comité Robotique France/TINTA

Sécurité, ergonomie et industrialisation

Dès sa conception, le Mirokaï a été pensé pour évoluer au contact direct des humains, dans des environnements où la sécurité ne peut souffrir aucun compromis. Cela se traduit par des choix techniques précis, comme l’utilisation d’actionneurs souples qui limitent les risques en cas d’interaction physique, mais aussi par une perception fine de son environnement grâce à un ensemble de capteurs capables de couvrir l’espace à 360°. Cette capacité à « voir » et à comprendre ce qui l’entoure lui permet de se déplacer de manière fluide, en s’adaptant aux flux et aux comportements humains, sans créer de rupture dans l’usage.

L’ergonomie joue également un rôle central. Le robot a été conçu pour être intuitif, lisible dans ses intentions et globalement rassurant dans sa présence. L’objectif est clair : faciliter son acceptation dans des lieux où la dimension humaine reste primordiale, comme les établissements de santé ou les espaces accueillant du public.

Au-delà du prototype, Enchanted Tools s’inscrit dans une logique d’industrialisation progressive. L’entreprise prépare une montée en production structurée, avec l’ambition de déployer plusieurs centaines de robots par an, en s’appuyant sur un écosystème industriel solide. Cette capacité à passer à l’échelle constitue une étape clé pour faire de la robotique humanoïde une réalité opérationnelle dans les années à venir.

Ils vécurent heureux avec les Mirokaï

Enchanted Tools défend une vision plus large de la robotique, où la machine ne se contente plus d’exécuter des tâches, mais devient une présence compréhensible et accessible. L’enjeu n’est plus uniquement de faire fonctionner un robot, mais de créer une relation avec lui, de le rendre lisible dans ses intentions et, d’une certaine manière, familier.

Character design d’un Mirokaï comme un personnage de jeu vidéo. ©Enchanted Tools

Pour y parvenir, l’entreprise développe un véritable univers narratif autour des Mirokaï. Chaque robot s’inscrit dans une histoire, avec une identité et une cohérence qui dépassent sa seule fonction. Ce travail sur l’imaginaire et le storytelling permet de transformer la perception que l’on peut avoir des robots, en les faisant passer d’outils techniques à partenaires d’interaction.

Cette approche ouvre des perspectives intéressantes pour l’acceptation sociale de la robotique, en particulier dans des contextes sensibles où la relation humaine est centrale. En rendant les robots plus intuitifs et plus attachants, Enchanted Tools contribue à poser les bases d’une cohabitation plus naturelle entre humains et machines.

Lauréat du Défi « Transfert robotique » 2023, le projet EXTENDER ambitionne de développer de nouvelles interfaces de commande pour un bras robotique destiné aux personnes en situation de handicap. Porté par la start-up ORTHOPUS en collaboration avec plusieurs laboratoires de recherche et établissements de santé, ce projet illustre concrètement la manière dont la robotique peut répondre à des enjeux d’autonomie et d’inclusion.

Au cœur du projet se trouve l’ORTHOPUS Explorer, un bras robotique fixé sur un fauteuil roulant électrique. Doté de six articulations et de doigts robotisés, il doit permettre à ses utilisateurs d’effectuer des gestes du quotidien : appuyer sur un bouton d’ascenseur, ouvrir un robinet, attraper ou déplacer un objet, utiliser un peigne ou encore interagir avec leur environnement de façon plus autonome.

L’enjeu du projet EXTENDER ne repose cependant pas uniquement sur la mécanique du bras robotique, mais surtout sur la manière de le piloter. Les équipes travaillent ainsi au développement d’interfaces de commande personnalisables et adaptées aux capacités de chaque utilisateur : joystick, commande vocale, capteurs de mouvements ou encore solutions immersives utilisant la réalité virtuelle.

Pour répondre à ce défi, ORTHOPUS s’appuie sur un consortium pluridisciplinaire réunissant plusieurs acteurs majeurs de la recherche française en robotique : l’ISIR (Sorbonne Université/CNRS), le LAAS-CNRS et l’équipe-projet AUCTUS d’Inria Bordeaux. Deux établissements de santé participent également aux essais précliniques : l’ESEAN – APF France handicap à Nantes et l’Institut Pascal à Clermont-Ferrand. Le projet intègre aussi une dimension en sciences humaines et sociales grâce au CETCOPRA (Université Paris 1 Panthéon-Sorbonne), chargé d’analyser les usages et les enjeux sociotechniques liés à l’acceptation du dispositif.

Photos d’un des premiers essais du bras robot dans un centre de santé spécialisé il y a quelques semaines.

Cette approche interdisciplinaire constitue l’une des spécificités d’EXTENDER. Les futurs utilisateurs, ainsi que des professionnels de santé comme des ergothérapeutes ou des spécialistes de médecine physique et de réadaptation, participent directement à la coconstruction de la solution. Les essais qui débutent actuellement dans les centres partenaires permettront d’évaluer l’ergonomie, le confort et l’intuitivité des différentes interfaces de commande développées par les roboticiens.

Les briques technologiques mobilisées dans EXTENDER proviennent en partie de travaux déjà développés dans des contextes industriels ou académiques. Elles doivent toutefois être adaptées à un usage particulièrement exigeant : permettre à une personne à mobilité très réduite de contrôler facilement un robot collaboratif installé sur un fauteuil roulant en mouvement.

À terme, les résultats de la phase de recherche seront transférés à ORTHOPUS afin d’engager l’industrialisation de l’ORTHOPUS Explorer et les démarches réglementaires nécessaires à sa mise sur le marché. À travers EXTENDER, les partenaires démontrent ainsi que la robotique peut devenir un véritable levier d’autonomie et d’inclusion, en plaçant les besoins des utilisateurs au cœur du développement technologique.

Les robots humanoïdes sont partout. Entre les démonstrations spectaculaires de Boston Dynamics, les annonces d’Elon Musk avec Optimus, les investissements massifs de Figure AI ou encore l’accélération fulgurante des acteurs chinois comme Unitree, la robotique humanoïde vit aujourd’hui une nouvelle phase d’ébullition mondiale. Mais derrière les vidéos virales de robots capables de courir, sauter ou danser, une question demeure : comment transformer ces démonstrations impressionnantes en systèmes réellement utiles, robustes et capables d’interagir durablement avec le monde réel ?

C’est précisément sur ces défis que travaillent depuis des années les chercheurs français, notamment au LAAS-CNRS, avec une conviction forte : l’humanoïde n’est pas seulement un objet technologique fascinant, c’est aussi un formidable laboratoire pour comprendre et reproduire certaines capacités humaines.

Comme le rappelle Olivier Stasse, chercheur au LAAS-CNRS, les humains réalisent chaque jour des tâches extraordinairement complexes sans même y penser : « Vous cherchez vos clés, vous vous penchez sous un lit, vous utilisez vos bras pour garder l’équilibre… Tout ce processus paraît naturel, mais lorsqu’on essaie de le reproduire sur un robot, c’est extrêmement compliqué. »

Olivier Stasse et l’un de ses “sujets d’expérimentation” ©Olivier Stasse

Cette complexité explique pourquoi, malgré les avancées spectaculaires de l’intelligence artificielle, les robots humanoïdes restent encore loin des capacités d’adaptation humaines. Pour faire progresser ces technologies, la France dispose désormais d’un atout stratégique : une plateforme robotique humanoïde complète au LAAS-CNRS. Pensée comme un véritable environnement d’essais et d’expérimentations, cette plateforme permet de tester des robots humanoïdes dans des conditions réalistes grâce à des systèmes de capture de mouvement ultra-précis, des équipements de sécurité, des capacités de calcul pour l’IA et une chaîne complète de validation mêlant logiciels, capteurs et mécatronique.

Depuis fin février, elle accueille notamment le robot H1v2 de la société chinoise Unitree, un humanoïde particulièrement remarqué pour ses capacités dynamiques. Ce robot, capable de sauter, courir ou absorber des impacts grâce à ses moteurs puissants, ouvre de nouvelles perspectives pour le déploiement d’approches d’apprentissage par renforcement sur des plateformes humanoïdes.

L’équipe Gepetto du LAAS-CNRS compte notamment s’appuyer sur ce robot pour transférer vers l’humanoïde des avancées déjà obtenues sur les robots quadrupèdes.

Cette convergence entre IA et robotique constitue aujourd’hui l’un des grands tournants du secteur.

Les nouvelles approches d’apprentissage permettent désormais à des robots de s’entraîner en simulation pendant des milliers d’heures… en seulement quelques heures de calcul. Olivier Stasse compare ce processus à l’entraînement sportif humain : le robot répète, échoue, corrige et finit progressivement par apprendre le bon mouvement.

Plus impressionnant encore, certaines approches récentes permettent désormais aux robots d’apprendre simplement en observant des vidéos humaines.

« Quand vous dites à quelqu’un : “Mets-toi debout”, vous ne lui expliquez pas la tension exacte de chaque muscle. Pourtant il y arrive. Aujourd’hui, on commence à voir apparaître ce type de mécanismes chez les robots, et c’est assez fantastique », explique Olivier Stasse.

Ces avancées restent cependant fragiles. Les démonstrations industrielles actuelles montrent encore des limites importantes en robustesse, en autonomie ou en répétabilité. Même les systèmes les plus avancés affichent souvent des taux de réussite partiels sur des tâches pourtant simples pour un humain.

Mais pour les chercheurs, l’enjeu dépasse la simple automatisation. La robotique humanoïde représente aussi une manière unique d’explorer la biomécanique, l’apprentissage, l’équilibre, la perception et l’interaction avec l’environnement. Elle oblige à faire dialoguer mécanique, intelligence artificielle, neurosciences et sciences du mouvement.

Et dans cette course mondiale, disposer en France d’une plateforme ouverte aux chercheurs et aux industriels constitue un levier stratégique majeur.

La plateforme du LAAS-CNRS permettra ainsi de soutenir des projets collaboratifs, des preuves de concept, des transferts technologiques et des expérimentations avancées autour des humanoïdes de demain.

Dans un domaine où les investissements internationaux se chiffrent désormais en centaines de millions, voire en milliards d’euros, cette infrastructure montre que la France possède elle aussi les compétences, les talents et les outils pour participer activement à la prochaine grande révolution robotique.

> Citations Olivier Stasse tirées de son entretien avec France culture

Le Comité Robotique France a organisé, sous l'égide du CEA-List, un webinaire sur la localisation et la navigation pour la robotique. Cet événement a rassemblé des experts du domaine, qui ont eu l'opportunité d'écouter des retours d'expérience concrets, d'explorer des solutions innovantes et d’échanger.

La robotique autonome révolutionne de nombreux secteurs, de la logistique à l'agriculture, en passant par les transports et les services publics. Au cœur de cette révolution se trouve la capacité des robots à se localiser et à naviguer de manière précise et fiable dans des environnements complexes et dynamiques. La localisation et la navigation sont des défis fondamentaux qui déterminent la performance, la sécurité et l'efficacité des systèmes robotiques autonomes.

Les intervenants :

Manon Cortal, CTO & experte LiDAR et robotique, Perception4D

Manon Cortal présentera « Localisation en environnement ouvert dynamique », elle partagera un retour d’expérience sur les défis de la localisation robotique dans des grands espaces dynamiques. À travers des cas réels, elle abordera les enjeux clés : détection et gestion des obstacles mobiles ou temporaires ; construction et utilisation de cartes multi-modales à grande échelle ; maintenance longue durée de ces cartes. Elle présentera des approches méthodologiques pour relever ces défis, communs à de nombreux usages de robots autonomes dans lemonde réel.

Hassan Bouchiba, CEO & expert 3D LiDAR SLAM, Exwayz

Depuis sa création en 2021, Exwayz se consacre au développement de logiciels de localisation LiDAR de pointe pour véhicules autonomes. Pionnière d'une technologie SLAM extrêmement robuste offrant une précision centimétrique, l'entreprise a rapidement acquis une reconnaissance nationale. Aujourd'hui, Exwayz accompagne des clients internationaux en déployant ses logiciels avancés afin d'étoffer ses équipes et ses technologies et de répondre aux exigences les plus élevées en matière de robotique industrielle.

Piloter, superviser et reconfigurer efficacement des robots industriels dans une cellule complexe, aucun problème pour SCORE.

Développé par le CEA-List, SCORE est un environnement logiciel de commande supervisée qui facilite la programmation et le pilotage interactif de robots industriels. Connecté à un jumeau numérique synchronisé en temps réel, il permet de visualiser, simuler et sécuriser les opérations pendant leur exécution, avec des fonctions d’anticollision et de guidage virtuel. Conçu pour les environnements exigeants, SCORE améliore la précision, la sécurité et l’efficacité des cellules robotisées, tout en réduisant la charge des opérateurs.

SCORE est un environnement logiciel conçu pour simplifier le développement d’interfaces de programmation robotique et de systèmes de commande supervisée.

Initialement pensé pour piloter des robots évoluant en environnements sévères ou à risque, SCORE s’est progressivement imposé comme un outil particulièrement adapté aux usages industriels avancés. Il fonctionne en complément de la suite logicielle CORTEX et permet un pilotage interactif en ligne, via un jumeau numérique synchronisé en temps réel avec le robot physique.

Grâce à ce jumeau numérique, les opérations peuvent être visualisées en 3D, simulées et sécurisées avant et pendant l’exécution. Le système intègre des fonctions d’anticollision, de guidage virtuel et d’assistance contextuelle, améliorant à la fois la précision, la sécurité et l’efficacité des tâches.

En pratique, SCORE permet de réduire la charge cognitive des opérateurs, d’optimiser les temps d’exécution et de fiabiliser les opérations complexes, par exemple lors d’assemblages d’équipements lourds nécessitant un positionnement précis avec de faibles tolérances. Le robot peut assister l’utilisateur dans les phases délicates, tout en garantissant la protection des pièces et de l’environnement de travail.

Une brique technologique qui facilite l’intégration des robots dans les ateliers et rend la robotique plus accessible, y compris aux non-spécialistes.

Acteur industriel majeur, Naval Group déploie une stratégie ambitieuse en matière de robotique industrielle, en s’appuyant sur un écosystème associant start-ups, laboratoires académiques et centres technologiques. L’objectif : inventer les solutions robotisées capables de répondre aux contraintes spécifiques de l’industrie lourde, tout en renforçant la souveraineté technologique française.

Cette dynamique s’inscrit pleinement dans les priorités de France 2030 et illustre le rôle structurant des coopérations entre grands groupes et recherche publique pour accélérer le transfert technologique vers l’usine.

AMATSUMARA : robotiser l’assemblage avant soudure

Parmi les projets emblématiques figure AMATSUMARA, sélectionné dans le cadre du Défi Transfert Robotique de France 2030. Le projet s’attaque à un verrou industriel majeur : l’automatisation de l’assemblage préalable à la soudure de pièces métalliques longues et lourdes, notamment dans des contextes de petites séries.

Si la robotique de soudage est aujourd’hui largement maîtrisée pour les productions répétitives, la phase d’assemblage reste, elle, très souvent manuelle. Or, cette étape est critique : il s’agit d’amener une pièce métallique de grande dimension et de forte masse dans une position 3D précise, avec une tolérance inférieure au millimètre, de la maintenir, puis de réaliser le pointage par soudure.

Il y a plusieurs enjeux techniques : la manipulation de charges lourdes et variables, la précision de positionnement sur grande longueur, la coordination bi-bras (« une main maintient, l’autre soude »), et l'intégration dans des environnements industriels complexes.

Il y a plusieurs enjeux techniques : la manipulation de charges lourdes et variables, la précision de positionnement sur grande longueur, la coordination bi-bras (« une main maintient, l’autre soude »), et l'intégration dans des environnements industriels complexes.

AMATSUMARA vise ainsi à développer une solution d’assemblage robotisé combinant force, précision et capacité à opérer sur de grandes dimensions. Le projet repose sur un consortium associant notamment Naval Group, le Groupe BRIAND, le LS2N, l’IRT Jules Verne, SERAAP, Proxinnov et plusieurs partenaires technologiques.

Les briques scientifiques mobilisées couvrent la préhension avancée, la robotique bi-bras, la modélisation dynamique des systèmes et l’optimisation des trajectoires. Le LS2N porte les travaux académiques, tandis que SERAAP assure l’intégration des solutions et que Proxinnov contribue à leur évaluation sur cas industriels réels.

Au-delà de la pure performance technique, ce projet revêt une dimension stratégique : automatiser ces opérations complexes pour améliorer la sécurité des opérateurs, accroître la précision des assemblages et renforcer la compétitivité industrielle.

Une approche écosystémique de l’innovation

À travers AMATSUMARA et d’autres initiatives, Naval Group illustre une approche collaborative de l’innovation robotique. En articulant besoins industriels concrets et recherche de pointe, l’entreprise participe activement à la structuration d’un écosystème national capable de concevoir les robots industriels de demain.

Le projet PARME (autre lauréat du Défi Transfert Robotique) explore la maintenance robotisée d’infrastructures métalliques en milieux exigus ou hostiles (cuves, cales, barrages), afin d’améliorer sécurité, qualité et durabilité des traitements anticorrosion.

Cette logique de co-développement, associant industriels, laboratoires et structures de transfert, constitue l’un des leviers essentiels pour accélérer le passage à l’échelle des solutions robotiques en France.

Un entretien approfondi avec Delphine Keller, Responsable Ligne Programme Innovation Usine du Futur chez Naval Group viendra prochainement éclairer les enjeux stratégiques et opérationnels de cette transformation.

Le GDR Robotique a réuni la communauté scientifique le 4 novembre au LIRIS pour une journée entièrement consacrée aux modèles de fondation appliqués à la robotique. Organisée au sein du Laboratoire d’InfoRmatique en Image et Systèmes d’Information (UMR 5205), cette rencontre a rassemblé des chercheurs et doctorants issus de laboratoires français et internationaux autour d’un même enjeu : comprendre comment ces nouveaux modèles peuvent transformer en profondeur la conception et les usages des systèmes robotiques.

Popularisés par l’essor des grands modèles de langage et des architectures multimodales, les modèles de fondation représentent une rupture majeure pour la robotique. Là où les approches traditionnelles reposaient le plus souvent sur des systèmes spécialisés, conçus pour accomplir une tâche précise dans un environnement bien défini, ces nouvelles architectures ambitionnent de doter les robots de capacités plus générales. En s’appuyant sur des données variées (texte, image, action, voire audio) elles permettent d’envisager des machines capables d’apprendre plusieurs tâches, de transférer leurs connaissances d’un contexte à un autre et d’interagir de manière plus naturelle avec les humains.

Popularisés par l’essor des grands modèles de langage et des architectures multimodales, les modèles de fondation représentent une rupture majeure pour la robotique. Là où les approches traditionnelles reposaient le plus souvent sur des systèmes spécialisés, conçus pour accomplir une tâche précise dans un environnement bien défini, ces nouvelles architectures ambitionnent de doter les robots de capacités plus générales. En s’appuyant sur des données variées (texte, image, action, voire audio) elles permettent d’envisager des machines capables d’apprendre plusieurs tâches, de transférer leurs connaissances d’un contexte à un autre et d’interagir de manière plus naturelle avec les humains.

Toutefois, la promesse scientifique s’accompagne de défis importants. Déployer ces modèles sur des robots réels implique de composer avec des contraintes matérielles, des limites de calcul embarqué et une dynamique physique bien plus complexe que celle des environnements numériques. Les questions de robustesse, de sécurité et d’adaptation aux incertitudes du monde réel occupent ainsi une place centrale dans les travaux présentés. La journée a permis d’illustrer combien le passage du modèle théorique au système opérationnel demeure un chantier scientifique à part entière.

Le programme a offert un panorama riche des recherches en cours. Les interventions ont abordé aussi bien l’inspiration biologique pour la conception des modèles que la manipulation robotique sur des horizons temporels longs, l’intégration conjointe de la vision et du langage, ou encore les apports des grands modèles de langage comme moteurs de raisonnement au sein de boucles de perception active. Plusieurs présentations ont également mis en lumière des applications concrètes, notamment en robotique de service et en manipulation d’objets, ainsi que le rôle déterminant de la simulation dans l’apprentissage robotique. Les environnements simulés apparaissent en effet comme des outils essentiels pour entraîner les systèmes, tester des stratégies et élaborer des abstractions adaptées avant leur transfert vers le monde physique.

Au fil des échanges, la journée a confirmé le dynamisme de la communauté et l’intérêt croissant pour ces approches hybrides, à la croisée de l’intelligence artificielle et de la robotique. Si cette rencontre marque le terme d’une séquence d’échanges formels, elle ouvre surtout de nouvelles perspectives de collaboration et de recherche. Les modèles de fondation, encore en pleine maturation, s’imposent progressivement comme l’un des axes structurants de la robotique contemporaine, appelés à redéfinir les capacités et les usages des robots dans les années à venir.

L’Union européenne vient de publier l’Apply AI Strategy, une nouvelle stratégie qui complète le plan “AI Continent” en passant cette fois à une logique très opérationnelle : accélérer l’adoption de l’IA dans les secteurs industriels clés (dont la robotique) et renforcer la souveraineté technologique européenne.

La nouveauté, c’est l’approche "AI-first" : chaque organisation, publique ou privée, est encouragée à considérer l’IA comme une solution potentielle dès la conception d’un projet, tout en privilégiant les technologies européennes et open source. La stratégie s’appuie sur des moyens concrets tels que le renforcement des EDIH (European Digital Innovation Hubs) transformés en centres d’expérience IA, les TEF (Testing and Experimentation Facilities) [cf. ci-dessous], sandboxes réglementaires, “AI Factories” et introduit une nouvelle gouvernance (Apply AI Alliance et AI Observatory) pour aligner politiques et besoins terrain. L’Europe passe d’une vision à l’action, avec un fort impact attendu sur les filières industrielles.

Pagination

- Page 1

- Page suivante